Vận động bằng AI, mặt trận mới trong cuộc bầu cử Ấn Độ

Hiện nay, người dùng cần cảnh giác với thủ đoạn sử dụng công nghệ Deepfake để lừa. Công an TP Hà Nội và TP.HCM cũng vừa đưa ra cảnh báo về thủ đoạn dụ dỗ "chat nhạy cảm" để cưỡng đoạt tài sản trên mạng xã hội .

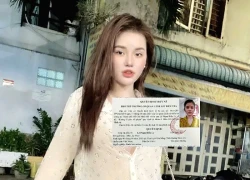

Vào tháng 5 vừa qua, ông T, ngụ tại quận 10, TP Hồ Chí Minh đã trình báo vụ việc bị lừa, chiếm đoạt hơn 450 triệu đồng. Thủ đoạn lừa của đối tượng là sử dụng hình ảnh của một người mẫu khá nổi tiếng trên mạng chủ động làm quen với ông qua mạng xã hội Facebook.

Ông T. và đối tượng đã trao đổi nhiều lần qua video call nên có được sự tin tưởng của ông T. Sau thời gian làm quen, lợi dụng lúc ông T. say rượu, đối tượng đã dẫn dụ nạn nhân "chat nhạy cảm". Sau đó, đối tượng đã sử dụng clip và hình ảnh đó để liên tục đe dọa, khống chế nạn nhân phải chuyển tiền nhiều lần, nếu không sẽ chuyển clip đến người thân và mạng xã hội của ông T.

Do bị khống chế, lo sợ sẽ ảnh hưởng đến uy tín và danh dự bản thân, ông T. đã phải chuyển cho đối tượng hơn 450 triệu đồng. Sau khi nhận được tiền, đối tượng tiếp tục khống chế đòi hỏi thêm nên ông T. đã trình báo Cơ quan Công an.

Theo báo Công an Nhân dân, các đối tượng sử dụng tính năng kết bạn, hẹn hò online... của các nền tảng và ứng dụng mạng xã hội như Facebook, Tinder, Zalo, Viber... để tìm cách làm quen qua mạng với nạn nhân.

Để tạo lòng tin với nạn nhân, các đối tượng có thể sử dụng các hình ảnh thật, thông tin thật lấy của những diễn viên hay các người mẫu chia sẻ trên mạng xã hội, sử dụng công nghệ AI deepfake (một phương thức tạo ra các sản phẩm công nghệ giả dưới dạng âm thanh, hình ảnh, video bởi trí tuệ nhân tạo) để tạo cuộc gọi video call theo thời gian thật tương tác thật với nạn nhân.

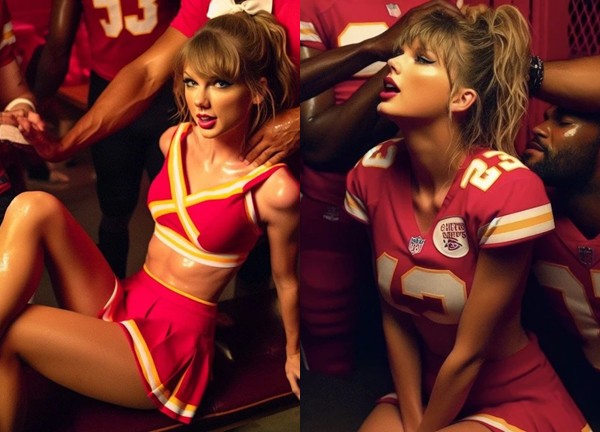

Hiện nay có rất nhiều công cụ thực hiện công nghệ deepfake với khả năng hoán đổi khuôn mặt có độ chân thực cao. Bằng cách sử dụng các thuật toán tiên tiến, các công nghệ đảm bảo mỗi giao dịch hoán đổi duy trì vẻ ngoài tự nhiên, không có dấu hiệu rõ ràng về thao tác kỹ thuật số do đó rất khó phát hiện bằng mắt thường.

Khi đã tạo được lòng tin và kết bạn với nạn nhân, các đối tượng sẽ tìm cách khai thác các thông tin đời tư, cá nhân, các mối quan hệ, các tài khoản mạng xã hội... để thu thập các thông tin của nạn nhân để tìm cách khống chế sau này. Nguy hiểm hơn chúng có thể dẫn dụ nạn nhân cài các ứng dụng (App) game, giải trí hay đầu tư... để qua đó cài đặt các mã độc vào máy điện thoại nạn nhân nhằm khai thác các thông tin trong danh bạ, thư viện hình ảnh, email, tài khoản ngân hàng...

Sau đó, các đối tượng sẽ lợi dụng lúc nạn nhân có chuyện buồn, cô đơn hoặc khi say xỉn... để dẫn dụ nạn nhân "Chat XXX". Khi video call chúng dùng AI để ghép mặt vào các clip nhằm làm nạn nhân lầm tưởng đang trao đổi với người thực.

Theo Người Lao Động, sau khi có được những hình ảnh, video này, các đối tượng sẽ yêu cầu bị hại phải chuyển tiền và đe dọa sẽ phát tán những nội dung này cho bạn bè, người thân, đồng nghiệp của bị hại hoặc phát tán lên mạng xã hội.

Nếu bị hại chuyển tiền theo hướng dẫn của các đối tượng, chúng lại tiếp tục yêu cầu bị hại chuyển thêm tiền với số tiền càng ngày càng tăng cho đến khi bị hại không còn khả năng tài chính. Vì lo sợ ảnh hưởng đến uy tín, danh dự nên hầu hết các nạn nhân đều ngại, không dám trình báo Cơ quan Công an.

Do đó, Công an TP Hà Nội đề nghị người dân cảnh giác khi nhận được lời mời, tin nhắn kết bạn từ người lạ trên mạng xã hội. Đặc biệt là các tài khoản dụ dỗ "chat nhạy cảm". Trường hợp bị đe dọa yêu cầu chuyển tiền qua hình thức nêu trên, đề nghị người dân đến ngay Cơ quan Công an nơi gần nhất để được hướng dẫn, giải quyết theo quy định của pháp luật.

Đặc biệt, theo công an, nạn nhân bị tống tiền đa dạng không chỉ nam, nữ mà cả các giới LGBT cũng có thể bị lừa đảo, tống tiền bằng các thủ đoạn trên.

Mua tổ yến nhớ nhìn điểm này thì hàng giả tinh vi thế nào cũng lộ, đừng để mất tiền oan  An Nhiên15:55:47 06/05/2024Tổ yến là một trong 8 thực phẩm bổ dưỡng nhất của tự nhiên, còn gọi là nhóm bát trân. Tổ yến có trị giá kinh tế cao và cũng có nhiều công dụng với sức khỏe.

An Nhiên15:55:47 06/05/2024Tổ yến là một trong 8 thực phẩm bổ dưỡng nhất của tự nhiên, còn gọi là nhóm bát trân. Tổ yến có trị giá kinh tế cao và cũng có nhiều công dụng với sức khỏe.

4 | 1 Thảo luận | Chia sẻ

1 | 1 Thảo luận | Chia sẻ

4 | 1 Thảo luận | Chia sẻ

4 | 1 Thảo luận | Báo cáo