Người dùng hoang mang khi bị lộ cuộc trò chuyện với ChatGPT trên Google

Sự cố nghiêm trọng về quyền riêng tư khi hàng nghìn cuộc trò chuyện ChatGPT bị Google công khai trên kết quả tìm kiếm, khiến người dùng hoang mang và đặt dấu hỏi lớn về bảo mật dữ liệu cá nhân trong thời đại AI.

Trong kỷ nguyên bùng nổ trí tuệ nhân tạo (AI), công cụ ChatGPT của OpenAI đang dần trở thành người bạn đồng hành phổ biến trong học tập, làm việc và giải trí. Tuy nhiên, mới đây, một sự cố nghiêm trọng liên quan đến quyền riêng tư đã khiến người dùng phải đặt câu hỏi về mức độ bảo mật thông tin cá nhân khi sử dụng AI.

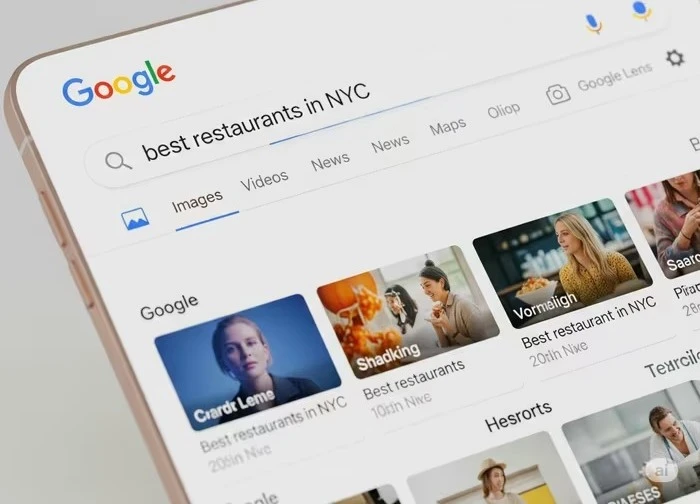

Một số chuyên gia bảo mật vừa phát hiện hàng nghìn đoạn hội thoại được tạo ra bởi ChatGPT có thể được truy cập công khai thông qua công cụ tìm kiếm Google. Những đoạn hội thoại này không đơn thuần là các câu trả lời mẫu hay bài hướng dẫn kỹ thuật, mà còn chứa đựng các thông tin nhạy cảm như tâm sự cá nhân, nội dung thảo luận công việc, dữ liệu y tế và thậm chí những lời thú nhận riêng tư.

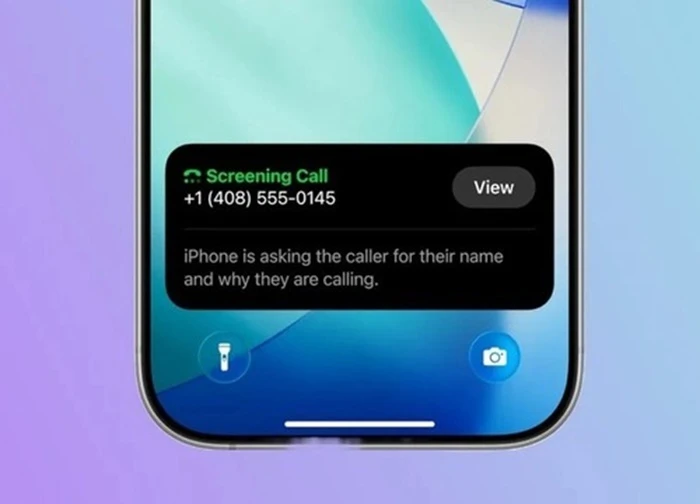

Nguyên nhân bắt nguồn từ tính năng " Share chat " mà OpenAI cung cấp cho phép người dùng chia sẻ cuộc trò chuyện với người khác thông qua một liên kết. Nếu người dùng chọn bật tùy chọn "Make this chat discoverable" (Cho phép cuộc trò chuyện có thể được tìm thấy), các đoạn hội thoại đó sẽ trở thành dữ liệu công khai, có thể bị các công cụ tìm kiếm như Google lập chỉ mục và hiển thị cho mọi người.

Tuy nhiên, giao diện của tính năng này chưa đủ rõ ràng, khiến nhiều người dùng nhầm tưởng chỉ đang chia sẻ riêng tư với bạn bè hoặc đồng nghiệp mà không biết nội dung đang được công khai rộng rãi trên Internet. Điều này vô tình dẫn đến việc hàng nghìn cuộc trò chuyện chứa thông tin nhạy cảm bị rò rỉ.

Ngay sau khi sự việc được phát hiện, OpenAI đã tạm ngưng chức năng chia sẻ cho phép tìm kiếm công khai và phối hợp cùng Google để gỡ bỏ các liên kết bị lộ trên kết quả tìm kiếm. Theo báo cáo từ Fast Company , có hơn 4.500 liên kết cuộc trò chuyện ChatGPT được chia sẻ công khai, một con số không nhỏ trong bối cảnh lượng người dùng công cụ này đang tăng nhanh chóng.

Sự cố này cảnh tỉnh người dùng rằng dù là công nghệ hiện đại đến đâu, thì việc chia sẻ thông tin trên nền tảng số vẫn tiềm ẩn nhiều rủi ro, đặc biệt khi người dùng không được cung cấp đủ thông tin minh bạch về cách dữ liệu được xử lý và lưu trữ.

Không ít người dùng ChatGPT dùng AI để viết email cá nhân, lên kế hoạch kinh doanh, mô tả tình trạng sức khỏe hoặc thậm chí chia sẻ những tâm sự riêng tư. Việc một thao tác nhỏ như bật chế độ chia sẻ có thể khiến tất cả những thông tin tưởng chừng chỉ mình biết lại bị công khai ngoài ý muốn, đặt ra nhiều câu hỏi về trách nhiệm của các công ty phát triển AI trong việc bảo vệ dữ liệu người dùng. Sam Altman – CEO của OpenAI – từng thừa nhận trong các cuộc phỏng vấn rằng các cuộc hội thoại với ChatGPT không được bảo vệ bởi các quy định pháp lý truyền thống về bảo mật dữ liệu.

Điều này đặt ra thách thức lớn trong bối cảnh AI ngày càng được ứng dụng rộng rãi trong các lĩnh vực nhạy cảm như chăm sóc sức khỏe, giáo dục hay tư vấn cá nhân, khi mà sự thiếu hụt các khung pháp lý rõ ràng khiến dữ liệu cá nhân dễ bị phơi bày hoặc bị sử dụng sai mục đích. Bên cạnh đó, những đoạn trò chuyện dù mang tính chất đùa vui hay thử nghiệm cũng có thể bị trích dẫn sai lệch khi bị công khai, gây ảnh hưởng nghiêm trọng đến người dùng.

Đây không phải lần đầu tiên các chuyên gia bảo mật lên tiếng về nguy cơ rò rỉ dữ liệu trong các mô hình ngôn ngữ lớn như GPT. Các nghiên cứu đã chỉ ra rằng mô hình có thể lưu trữ một phần dữ liệu từ các cuộc trò chuyện trước đó và vô tình tái hiện lại khi có người dùng "hỏi đúng cách". Kỹ thuật được gọi là "reconstruction attack", cho thấy rằng AI không hoàn toàn xóa sạch ký ức giữa các phiên làm việc mới, từ đó gây ra rủi ro bảo mật tiềm tàng. Nguy cơ này phụ thuộc vào cách thức huấn luyện, cập nhật và kiểm soát mô hình, đồng thời đòi hỏi các công ty phát triển phải tăng cường biện pháp bảo vệ và giám sát nghiêm ngặt hơn.

Sự cố rò rỉ hàng nghìn cuộc trò chuyện ChatGPT là lời cảnh tỉnh mạnh mẽ cho người dùng và cả các nhà phát triển công nghệ về tầm quan trọng của quyền riêng tư trong thời đại số. Dù AI đem lại nhiều tiện ích vượt trội trong việc hỗ trợ sáng tạo nội dung, tiếp cận tri thức và tự động hóa công việc, thì nguy cơ mất kiểm soát dữ liệu cá nhân vẫn hiện hữu rõ ràng.

Người dùng cần nâng cao nhận thức, cẩn trọng hơn khi chia sẻ thông tin trên các nền tảng AI, đặc biệt là những nội dung nhạy cảm hoặc riêng tư. Đồng thời, các công ty phát triển công nghệ phải đảm bảo minh bạch trong quy trình thu thập, lưu trữ và chia sẻ dữ liệu, cũng như nhanh chóng khắc phục những lỗ hổng bảo mật khi được phát hiện.

Phát hiện bàng hoàng về ChatGPT  Việt Anh21:22:38 03/08/2025Sam Altman, CEO của OpenAI, từng lên tiếng cảnh báo người dùng không nên chia sẻ những chi tiết cá nhân nhạy cảm với ChatGPT. Ông thừa nhận rằng công ty có thể bị buộc phải cung cấp những thông tin đó nếu có yêu cầu hợp pháp từ tòa án.

Việt Anh21:22:38 03/08/2025Sam Altman, CEO của OpenAI, từng lên tiếng cảnh báo người dùng không nên chia sẻ những chi tiết cá nhân nhạy cảm với ChatGPT. Ông thừa nhận rằng công ty có thể bị buộc phải cung cấp những thông tin đó nếu có yêu cầu hợp pháp từ tòa án.

3 | 0 Thảo luận | Báo cáo